最近,大家可能已经见识过 AI 的威力了吧,以 ChatGPT 为代表的 人工智能(AI)展现出接近人一样的回答水准。

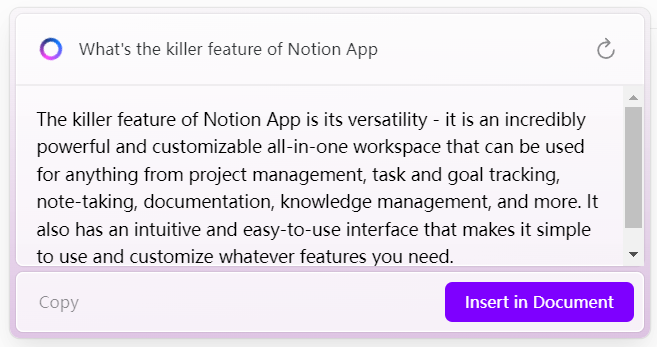

来自 Craft AI Assitant

AI 就在那里,是房间里的大象,大家不能总装做对自己没有影响。要知道,此时的 AI 和 以往的AI相比,已经截然不同了。

以往的 AI :

- 按照指定套路,在指定领域回答问题。(也就是所谓的「专家系统」)

- 和人类下下国际象棋,靠算力取胜。 (不讲武德)

- 生成海报,设计PPT, 让大家摆脱加班。(不,腾出时间加班做更多的事情)

- 下赢围棋,让人类选手哭。 (似乎剧情发展已经不太对劲)

最近此刻大火的 AI:

- 根据要求,生成惟妙惟肖的图像,似乎有干掉一些插画师的潜力。

- 归纳一下长篇报告,翻译一段文案,听写会议记录…… 似乎有干掉文员的潜力。

- 查询一些前人的知识,引经据典,提出观点,貌似有进行科学研究的潜力。(至少,玄学研究中,肯定可以用得上)

忽悠甲方,随便编些理由敷衍老板 ,小菜一碟

……

从时间上来看,现在的 AI 有了「质的飞跃」,更像是一个有想法,有知识的活人了,虽然还是停留在「嘴炮」级别,没有什么实践经验。不过话说回来,似乎很多人类选手也未必有什么实践经验。

写到这里,我想起了手机上S打头的「弱智语音助理」, S属于以往「那个时代」的 AI,我几乎没怎么用过它。 除了偶尔询问个天气,请它记个提醒(它还经常记错)。哦,对了,它会说一些很尬很冷的笑话。 等我写完这篇文章,我要问问手机, 「你看看人家的AI,怎么这么厉害,你怎么……」 这会伤了它的自尊吗?我表示怀疑。

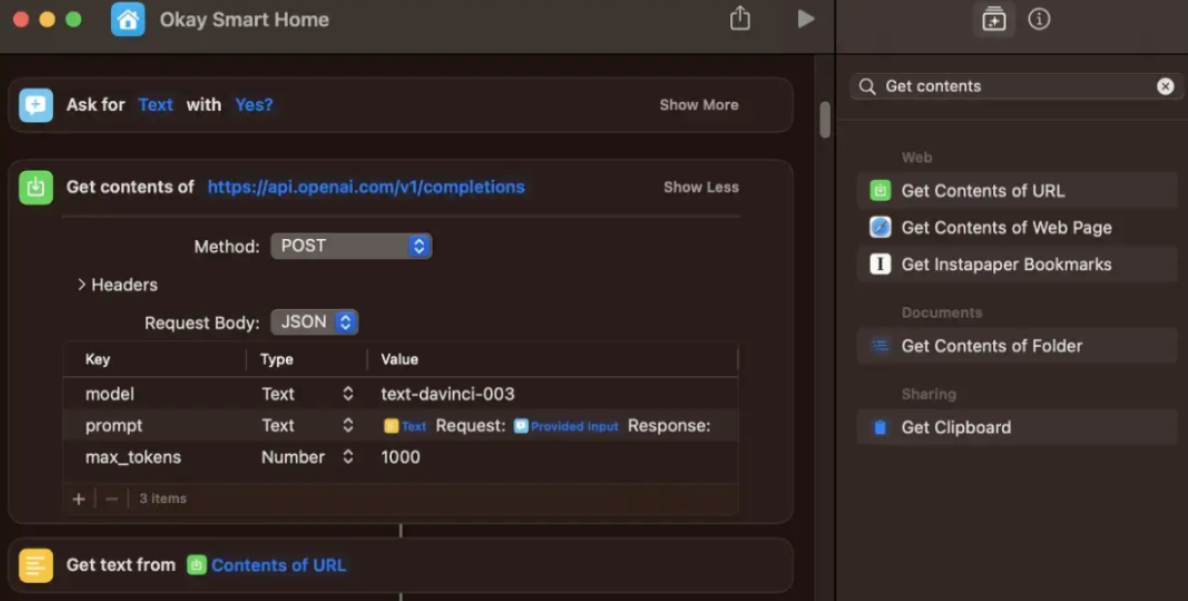

已经有人放出了 用 Siri 调用 ChatGPT 的快捷方式

但我转念一想,还是不要去嘲笑手机了吧? 你想,在手机上配备更高级的AI,那只是厂商打个响指就能发生的事情。还是担心担心我们自己吧,AI 打个响指,我们的饭碗可能就没了。 当然,我这里特指「知识工作者」的饭碗。知识相关领域的工作,才是 AI 展开「屠杀」的主战场。

如果是一颗核弹

AI 对我们的影响,至少有三种可能的级别:

- Level I,AI 对我们影响很低,我们一笑了之,关起门继续嘲笑手机的语音助理。 从目前来看,除非从今天起,我们立法让 AI 原地踏步,否则这个情况不太可能发生。

- Level II,AI 会威胁到一部分脑力工作者的职位。 那赶紧挖个坑,把头埋进去,祈祷倒霉的肯定不是我。

- Level III,AI 会威胁到现在大部分的脑力工作者,很多工作会发生「彻底的变化」(直白点说,消失),就像扔下一颗核弹,嘭~ 什么东西都被蒸发了。

如果是 Level III 级的影响,该怎么办?

很多人会搬出蒸汽机刚诞生时的例子。当时,有些纺织工人对机器带来的人类失业感到愤怒,并砸毁机器。即使如此,我们也看到了,历史潮流不可逆,人们终究会创造出更好的工作岗位,而且是机器不能取代的岗位,最终实现经济更高的增长。 这是我们看到的历史,也是我们信心的来源。

来自 Wiki

要我的观点来说,高度自动化的机器,无论是蒸汽机驱动也好,内燃机驱动也好,电力驱动也好,充其量只是代替体力劳动。 这种趋势在这几个世纪里逐渐把人们往脑力工作上驱赶,而 AI 的效果则是把人们逐渐从脑力工作里面赶出去,难道让我们重新回到体力工作中去? 在「脑力」和「体力」以外的地方,如果没有工作可寻,那么,AI 不就是一颗「蒸发一切」的核弹吗?

首先,我要提醒各位,调戏「高级 AI」,不同于调戏手机的语音助理,和「高级AI」对话的时候,一定要有礼貌,尽量用「请」,「谢谢」。主要是防止 AI 崛起以后,找大家寻仇。

然后,我们来认真想想,哪些工作,尤其是脑力工作,我们还能抢救一下的。这些可能的脑力工作集合,就是一个「末日避难所」。

寻找「避难所」

先看看,AI 能做什么

从此时此刻的 AI 来看,AI 通过机器学习,通过人工训练,不断迭代自己的模型,从而高效的吸收了来自我们 互联网(或其它书面渠道)数十年以来积累的知识。

AI 的学习效率很高,处理信息的能力自然不用说。就是知识传承方面也远比人类的教育体系先进,AI 一旦训练完成,可以代代几乎0成本传承,而人类则要每隔一代花个十几年到几十年,训练下一代人类还要从头开始掌握知识,成本居然如此之高。所以想要拼学习速度,我们不是AI对手。

我们的知识广度也不如 AI, 在某些专业领域,目前人类可能远胜于AI,但是这些领域如果有价值,早晚会被AI用来学习。 例如:人力资源评估这类事情,已经有海外大厂在做了,AI 的评估可能会更全面,而且不带个人感情。

对不起,是 AI 要裁掉你的, 我也没办法呢

更进一步,或早或晚,我们的最新创作成果一旦发布,就会成为 AI 学习的素材。 如果它有价值,AI 很快就能做出类似甚至更好的作品。 已经有报道表明,画师原创性的价值,逐渐被 AI 模糊化了,AI 的「借鉴」算是「剽窃」吗? 类似的情况,还有音乐的作曲,甚至报社编辑,小说戏剧作者 …… 这只是一个时间问题。

我们做得越好,AI 就会变得越强,我们将来的「内卷」方向是和 AI「互卷」,那时候我们会怀念人与人的之间「内卷」,那真是太温柔了。

所以,一个简单的推论就来了, 既然拼不过AI,那就加入AI。 等等,等等,我不是说数字永生,脑机接口之类的,我说的是眼下这几年,大家可以准备的事情。

给 AI 带路

是的,让 AI 快速成长,快速普及,也是一种短期的避难手段(听起来有种助纣为虐的感觉?)。

我们所在行业,如果不可避免要被 AI 颠覆,不如让它快点发生。 在这个过程中,需要 很多人类去帮助和训练 AI。即使是使用 AI,也是一种对AI的训练。 目前来看,AI 模型的初期确立,并不是「野生放养」得来的。整个学习中,还需要大量人力去调校,维护和纠偏。 例如:

- 初代 AlphaGo 需要人类棋手的经验和指导(当然以后就不用了,甚至也不配了)

- 现在的 ChatGPT 就需要人力去限制甚至审视它的言论,帮助模型不要被「污染」

- 现在的图片生成 AI 应用当中,有的可以人工设置权重,让 AI 更了解人类的偏好

将来 AI 进入专业领域后,也会有类似的事情发生。 无论我们自己如何不愿意帮助或参与 AI, 但总有人会愿意的。

就短期而言, 诸如:具体应用到哪个业务场景,运用哪些参数,也还是人类可以探索的空间。 给 AI「带路」,这本身就是一种知识工作。 我们已经看到了一些公司争先恐后投入其中的例子,例子多得不胜枚举:

- 将 AI 运用到文字转配音

- 将 AI 运用到音视频剪辑上

- 将 AI 运用到会议记录,记录整理之上

- 将 AI 运用到去除背景噪音,扣除背景图片之上

……

我们运用 AI,或者帮助别人运用AI,不仅会帮助 AI 成长,也给自己创造了工作机会。更重要的是,这也是熟悉和发现 AI 优势和弱势的机会。 我们只有了解对手,才能更好地超越对手。我可不想在 AI 擅长的地方和它死磕。

所以,不要害怕,拥抱 AI,同时寻找机会打造「避难所」。

占领一些「高地」

显而易见的是,有些事请不是 AI 不能做,而是 人类会设置壁垒禁止 AI 进入。为什么会有壁垒?可能是责任的原因,可能是惯例的原因,甚至可能是伦理的原因,至少,相当一段时间内 AI 会被隔离在外。

例如:AI 可以引用法律法条,分析案情卷宗,但是不能出庭提供辩护协助。 近日美国某些律师工会已经威胁 AI 出庭将触犯法律,或导致 AI 公司负责人入狱,原因是 AI 没有从业执照(*)。

法律援助 AI 公司创始人,Joshua Browder, 图来自NPR公开报道

不少知识工作,尤其是有行业协会的那种,或需要执照的那种,短期内 AI 还很难染指。这不是说,我们可以高枕无忧。 这类工作只是短期安全。 而另一方面,即使现在安全,AI 也肯定提高了该行业的平均生产力水平,例如:律师的助理可能就不需要了,一个律师可以处理更多案子了。 如果没有那么多案子,律师的绝对数量就显得过剩了,所以,要生存下去,可能需要在行业里面爬到「高地」的位置。(或者,难道为了工作去人为去制造更多案子?)

这和大规模生产带来了产能过剩类似,体力工作者早就经历过几遍了,接下去要轮到脑力工作者了。 但无论哪种工作,占领「高地」的都是幸存者。(就像资深的产业熟练工仍旧吃香)

寻找「隐性知识」

谁说知识就一定是存储在互联网上或者书本里面的?知识也可能是「隐性」的。

我说的「隐性知识」不是专指「人情世故」那套关系学,而是说,AI 由于无法实践,也无法习得的知识。(当然「人情」也是其中之一)

虽然,AlphaGo 下围棋这类特定领域的 AI,不需要生活经验,而且到达一定阶段后就能脱离现有书面知识进行「自我实践」。但相当一部分的 AI 目前最致命的弱点是,不能参与实践,只能依赖已有资料。

AI 可以侃侃而谈香蕉,但是它从来没有吃过真正的香蕉。他的所作所为就像是有些「纸上谈兵」的项目咨询师。苹果公司创始人 乔布斯 在 MIT 1992年的演讲时,就是这样形容某些咨询公司的(*)。

来自 MIT 公开的演讲视频

因此,几乎可以肯定的是,存在 AI 看不见的「隐性知识」,在没有可学习资料的领域里面,人类还远没有「一败涂地」。

只要不断总结自己实践经验,我们就能获得 AI 没有的一些优势,至于这种经验有没有价值,有多大的市场,那是另外一回事。

正如最近大家都喜欢分享自己的「知识管理体系」,就是一种实践的总结,当然其中各有特色,有些也是偏「纸上谈兵」,但那些真正靠实践得来的经验,多少能给人以共鸣和启发,这不是 AI 通过模仿或学习可以得来的,虽然 AI 也有自己的知识体系和实践经验,但对人类而言没有什么价值(就是那些 AI 模型了,我们的大脑配不上)。

提高自己的「逻辑能力」

现代的科学体系是基于逻辑的。对于知识工作者来说,「逻辑能力」是基本功。 我要指出, 「玄学类」的工作不在此范围里,玄学依赖于解释,而不是坚实的推理,不同的人可以给出不同的答案,这反而让 AI 的 「胡说八道」有了用武之地。

AI 的确有一定的因果分析能力,但是,正如前文所说,这些都是从学习材料得来的,而且是形式上的逻辑。 这些材料肯定没有第一手的实践来得靠谱,有的时候,AI 的判断甚至非常「反现实」。 由于目前的 AI 机制所限,通过机器学习得来的模型,AI 自己甚至也无法清晰的解释为什么会得出这个结论,有人说这只是一种「拟合」而已。也有人说 AI 更像是非常复杂参数体系下的「统计学」,当然,说不定人脑也不过如此。 不排除 AI 将来具有「自我解释」的能力。 但目前来看 AI 的逻辑和解释能力是显著低于人类的。(不是所有人,有的人逻辑能力也未必如AI) 下图是一个逻辑上矛盾的AI回答,AI 可能不擅长于此。

鸡兔同笼,试了几次几乎都不能答对,而且解释很矛盾

而人类的整个科学知识体系是建立在一个逻辑严密的「知识树」上的。 因此 AI 或许可以很大程度启发我们,但短期内不能代替我们在一些要求逻辑严密的领域里做出分析和决策。

最后

其实在这个阶段,就言之凿凿的预测未来是件不明智的事情。但出于未雨绸缪的考虑,想到极端情况下,我们能否在 AI 时代 安身立命,避开风险,因此斗胆给各位提了一些自己有限脑力下的想法。

我保证,全程没有借鉴 AI 的 「一派胡言」,即使在将来我的观点可能远不如 AI,但我还是不喜欢当前 AI 胡乱拼凑出来的文章。至少,「让大家拥抱AI」这种观点也不是 AI 指使我提出的,我是友军,大家不要开火。

最后,大家有什么可以在未来 AI 时代生存的方法或技巧,欢迎留言分享,大家互通有无,争取早日恢复人类知识工作者的尊严,而不是被 AI 取代。

原文链接:https://blog.csdn.net/2301_77531618/article/details/130447755?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522170018760416800182758208%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=170018760416800182758208&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-7-130447755-null-null.nonecase&utm_term=AI%E6%B3%95%E5%BE%8B%E5%92%A8%E8%AF%A2