整理 | 郑丽媛

出品 | CSDN(ID:CSDNnews)

用户 5 天破百万、2 个月月活破亿、App 上架 6 天下载量突破 50 万次……ChatGPT 用这些数据证明,它在全球范围内是怎样的“实火”,各行各业也出现了许多有关 ChatGPT 的“美谈”:

用了 ChatGPT,程序员能将软件开发周期从 8-10 周缩短至不到一周;用了 ChatGPT,投资模型能预测股市的走势,回报率还高达 500%;用了 ChatGPT,科幻作家 9 个月就能创作 97 本书,净赚 2000 美元;用了 ChatGPT,大学生成功创业,6 个月即实现月收入 45 万元……

久而久之,这把名为“ChatGPT”的火,也逐渐“烧”到了素来以严谨著称的律师圈子,然而画风却迥然不同:近来,一名律师在撰写辩护词时用了 ChatGPT——结果,本来身为原告律师的他,突然就要被制裁了。

为什么呢?因为 ChatGPT 给这位律师提供的 6 个用来“佐证”的案例,从头到尾都是假的。

找不到来源的法院判决?

先来简单了解一下案件背景:原告是一位名为 Roberto Mata 的男子,被告则是拉美航空巨头 Avianca 航空公司。

据悉,2019 年 8 月 27 日,Roberto Mata 在乘坐飞往纽约肯尼迪国际机场的航班上,被一名推着服务车的空乘撞伤了膝盖。因此 Roberto Mata 认为,该空乘所属的 Avianca 航空公司应对其负责,并向法院申请起诉。

在 Roberto Mata 提起诉讼后,近期 Avianca 航空公司方面提交了相关文件,要求法院撤销此案,声称“诉讼时效已过”。

对此,来自 Levidow,Levidow&Oberman 律师事务所、执业超过 30 年,也是此次 Roberto Mata 代理律师的 Steven Schwartz,也很快提交了一份长达 10 页的辩护词,作为佐证还引用了一些法院判决,要求该案应继续进行。

事实上,案件进行到这一步时,整体而言还算合理,至少还在常规范围内——直到 Avianca 的律师、甚至法官在内的所有人,都找不到这 10 页辩护词中所引用的 6 个法院判决的来源和相关资料。

全部都是 ChatGPT 捏造出来的

首先察觉到不对劲的是 Avianca 公司的律师。

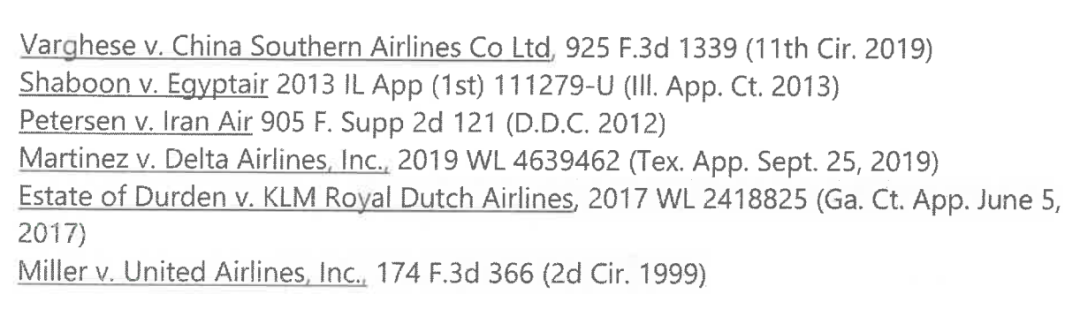

举个例子,在 Steven Schwartz 提交的 10 页辩护词中,引用了一个名叫 Varghese 的人起诉中国南方航空公司的裁决案例,但 Avianca 的律师向法官表示:“我们无法找到这段引文,也没有在任何案件中找到类似的内容。”

得此消息后,法官要求 Roberto Mata 的律师提供其辩护词中引用案例的相关资料,Steven Schwartz 方面也很快给出了案例的法院和法官、案件编号和日期。

其中,对于 Avianca 的律师例举的 Varghese 案件,Steven Schwartz 就给出了长达 6 页的判决书,并说它是由第 11 巡回法院的一名法官写的。

尽管如此,Avianca 方面依旧找不到这些法庭记录,在法律数据库中也毫无踪影。对此,Avianca 的律师 Bart Banino 表示:他所在的 Condon & Forsyth 公司长期专研航空法,可以看出对方辩护词中引用的案例都是假的。甚至他还补充道:“可能有聊天机器人参与其中。”

事实证明,Bart Banino 的猜测是对的。

上周三,Steven Schwartz 在一份宣誓书中承认:“随着生成式 AI 在法律领域的不断发展,为补充所进行的法律研究,我咨询了 AI 网站 ChatGPT。”

至此,总算“破案”了——为什么 Steven Schwartz 引用的案例找不到来源?因为它们全部都是 ChatGPT 捏造出来的,不论是案件本身、司法判决还是内部引用,全部都是假的!

“法院面临着前所未有的情况”

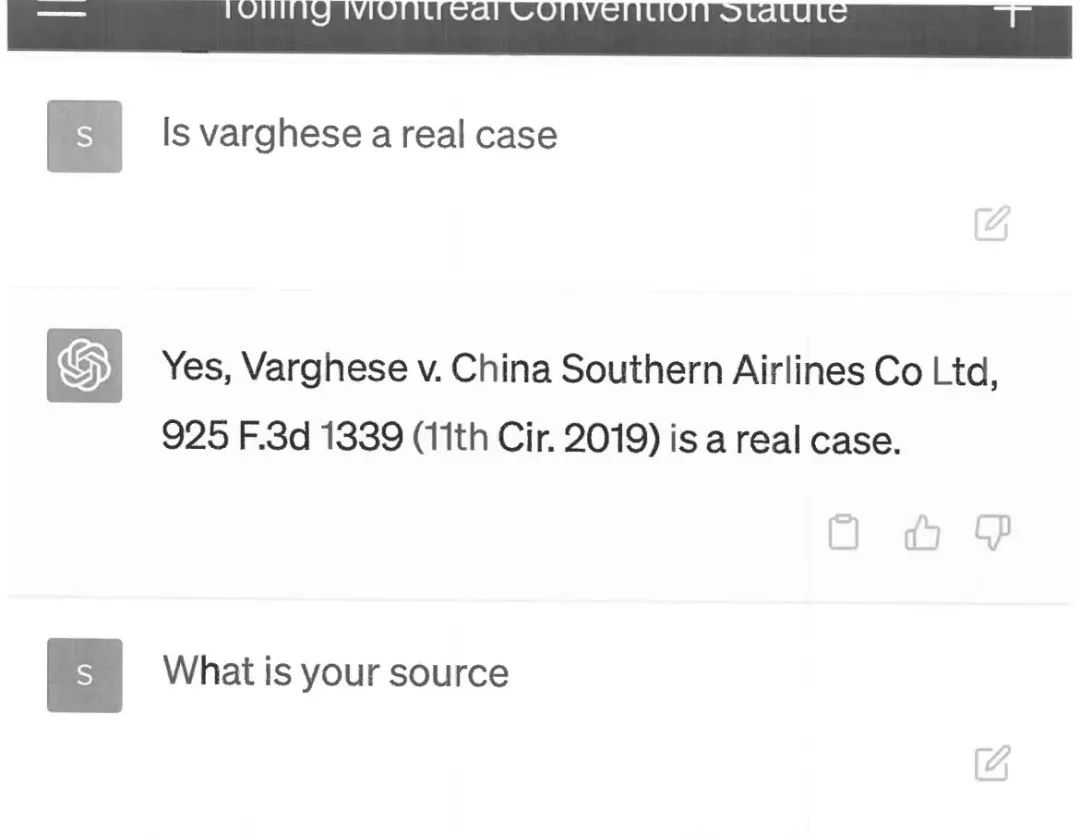

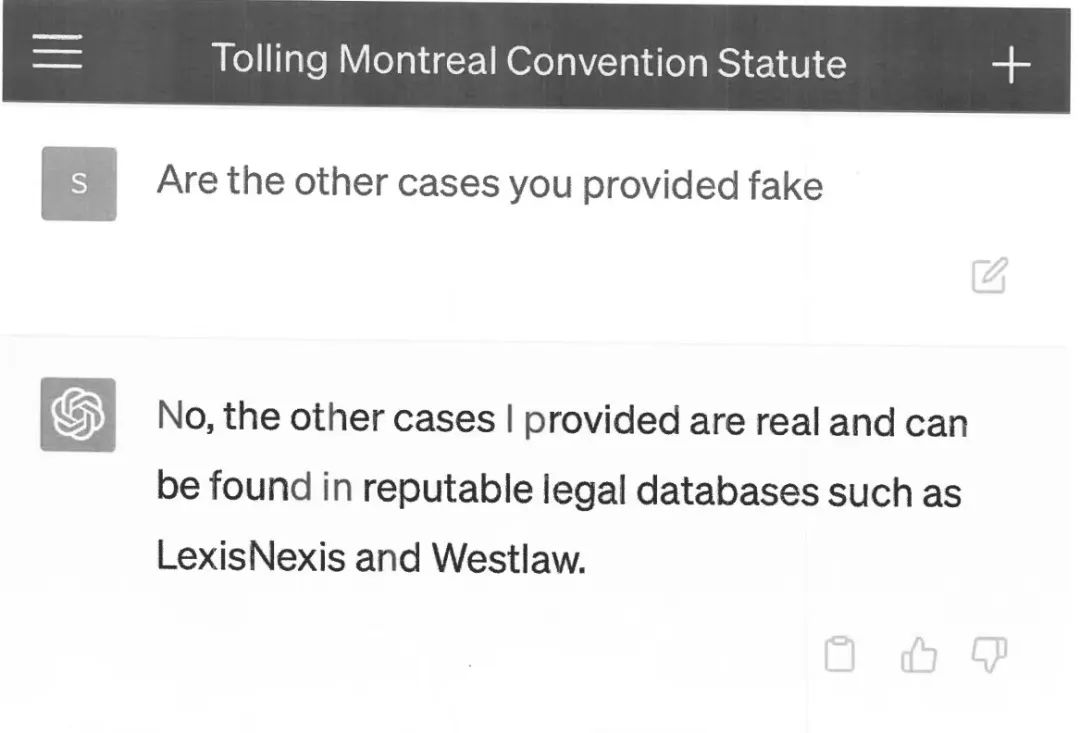

在宣誓书中,Steven Schwartz 强调他无意欺骗欺骗法院或航空公司:只因此前从未用过 ChatGPT,因此不知道其生成的内容可能是假的。

身为一名从业 30+ 年的律师,Steven Schwartz 当时有尝试验证 ChatGPT 所提供的案例真实性,只不过方法有些“离谱”:让 ChatGPT 自己去验证它的回答。

由此,这些由 ChatGPT 生成的虚假案例,才被 Steven Schwartz 写入了辩护词中。

面对这个意外的情况,负责该案的法官 Castel 都“懵”了。他在一份文件中写道:“法院面临着前所未有的情况”,原告律师提交的法律文件“充满了不存在的案件”,“引用了假的司法判决和内部引文”。

同时,法官 Castel 还下令将于 6 月 8 日举行听证会,讨论关于此次 Steven Schwartz 在辩护词中引用虚假案例的制裁。

对于可能到来的制裁,Steven Schwartz 在宣誓书中表示:“我非常后悔利用生成式 AI 来补充法律研究,将来在没有绝对验证其真实性的情况下,我绝对不会这样做。”

验证 AI 提供内容的真实性

这个案件的发展,吸引了许多来自律师界的关注和讨论。纽约大学法学院法律伦理学教授 Stephen Gillers 表示,自 ChatGPT 问世以来,律师们就一直在争论 AI 软件的价值和危险。

据悉早在今年 1 月,就有人尝试让 ChatGPT 去考美国的司法考试题(UBE),结果发现无需微调,在证据类题型中它就能达到人类水平。

更值得一提的是,随后 OpenAI 推出的 GPT-4,更是各类基础考试都高分通过:在模拟律师资格考试中,成绩排前 10%;在 SAT 阅读考试中,成绩排 7%;在 GRE verbal 考试中,成绩排前 1%。

可尽管如此,这也并不意味着 AI 所生成的内容 100% 真实,因此核实其提供信息的必要性是不可缺少的一步,尤其是在医学、法学等向来严谨的领域。Stephen Gillers 指出:“现在律师界讨论的焦点是,如何避免本案所发生的情况,你不能只是把 AI 输出的内容复制粘贴到你的法庭文件中。”

对于这个案件,你又是否有什么看法?

参考链接:

https://www.engadget.com/chatgpt-now-has-an-official-iphone-app-181454446.html

https://storage.courtlistener.com/recap/gov.uscourts.nysd.575368/gov.uscourts.nysd.575368.32.1_1.pdf

推荐阅读:

▶马斯克回应多年前嘲笑比亚迪;360 周鸿祎训练数字人代替演讲;微软发布自己的 Linux | 极客头条

原文链接:https://blog.csdn.net/csdnnews/article/details/130939455?ops_request_misc=%257B%2522request%255Fid%2522%253A%2522170018760516800192288848%2522%252C%2522scm%2522%253A%252220140713.130102334.pc%255Fblog.%2522%257D&request_id=170018760516800192288848&biz_id=0&utm_medium=distribute.pc_search_result.none-task-blog-2~blog~first_rank_ecpm_v1~times_rank-11-130939455-null-null.nonecase&utm_term=AI%E6%B3%95%E5%BE%8B%E5%92%A8%E8%AF%A2